InterMacki - Monitoring mediów elektronicznych

Prywatność to fikcja. Jak to powiedział już pewien pisarz: „Wojna to pokój. Wolność to niewola. Ignorancja to siła.”

Jeśli i tu będzie pozytywny odzew, następny wpis będzie o monitoringu wizualnym, czyli o tym, co kryje się za otaczającymi nas z każdej strony kamerami.

Monitoring urządzeń elektronicznychW dobie szalonego rozwoju informatyki i systemów elektronicznej wymiany informacji, służby specjalne muszą mieć kontrolę nad coraz większą ilością danych. Wyłowienie z ich natłoku tych, które są krytyczne dla danego śledztwa nie jest możliwe nawet dla super-genialnego człowieka. Nasze zdolności percepcji są bardzo ograniczone, a wprowadzanie coraz to nowych urządzeń, metod wymiany informacji czy wymyślanie nowych kanałów komunikacyjnych uniemożliwiają skuteczną inwigilację bez specjalistycznych narzędzi.

Podstawową rzeczą, z jakiej musisz sobie zdać sprawę jest fakt, że poza „wynalazkami” zapaleńców-geniuszy, żaden wynalazek związany z przetwarzaniem danych czy komunikacją wyprodukowany przez wielkie firmt nie zostaje dopuszczony na rynek, jeśli nie mogą go „podsłuchać” służby specjalne. Paranoja ? Jeśli tak myślisz, zapytaj twórców LotusNotes z IBM, dlaczego podczas szyfrowania wiadomości używają dwu kluczy, publicznego jawnego i publicznego NSA. Przejdźmy w takim razie do konkretów.

Zdalny monitoring urządzeń elektronicznychStawianie najbardziej wyrafinowanych firewalli nie na wiele się zda, gdy ktoś “podejrzy” nasze dane, analizując promieniowanie elektromagnetyczne komputera, monitora czy drukarki. Taki sposób podsłuchiwania to nie science fiction, ale technika znana od... 100 lat.

W ostatnich latach panuje moda na bezpieczeństwo danych, a zagrożeń upatruje się głównie w Internecie. Danych na dyskach twardych coraz pilniej strzegą nie tylko firmy czy instytucje zobowiązane do tego przepisami o ochronie danych niejawnych, ale także zwykli użytkownicy pecetów. Na nic jednak wymyślne software’owe i hardware’owe zapory ogniowe, gdy bez trudu i bez włamywania się do Sieci można podejrzeć zawartość ekranu.

Mówiąc o ochronie informacji, z reguły myśli się o uniemożliwieniu bezpośredniego korzystania z komputera, o zabezpieczeniach związanych z kontrolą dostępu czy kryptografią. Stosunkowo mała liczba osób zdaje sobie sprawę, że istnieją również inne zagrożenia. Nasze komputery “podglądać” można zdalnie, wykorzystując ich emisję elektromagnetyczną. Przez szereg lat żadne wzmianki na ten temat nie pojawiały się w ogólnie dostępnych źródłach, a zagadnienia związane z tzw. przenikaniem elektromagnetycznym (ang. electromagnetic leakage) czy wykorzystywaniem w urządzeniach i systemach teleinformatycznych środków tzw. ochrony elektromagnetycznej (określanej często kryptonimem Tempest) znane były wyłącznie dla wąskiego kręgu specjalistów pracujących dla cywilnych i wojskowych służb specjalnych.

Zagrożenia związane z bezprzewodowym przenikaniem informacji stają się bardziej oczywiste, jeśli uświadomimy sobie, że każde urządzenie wykorzystujące do swej pracy energię elektryczną jest źródłem promieniowania elektromagnetycznego. Jeżeli zmiany natężenia prądu płynącego w obwodach naszego peceta są efektem przetwarzania przez nas określonych informacji, to w przestrzeni rozchodzi się fala elektromagnetyczna również odzwierciedlająca te dane. To niosące informacje promieniowanie może być odbierane nawet w znacznej odległości od peceta, monitora czy drukarki. Co więcej, może ono także powodować powstawanie w pobliskich instalacjach prądów, które również umożliwią odczytanie oryginalnie przetwarzanych danych. Jeżeli więc nie stłumimy sygnałów emisji ujawniającej (ang. compromising emanations), to umożliwiamy działanie “elektromagnetycznym podglądaczom”.

To, że infiltracja elektromagnetyczna nie jest tylko bajką o żelaznym wilku, udowodnił w 1985 roku naukowiec Wim van Eck, pracownik Neher Laboratories of the Netherlands. Wykazał on, że w sprzyjających okolicznościach za pomocą stosunkowo prostego nawet w tamtych czasach sprzętu mieszczącego się w niedużym samochodzie możliwe jest odtwarzanie informacji przetwarzanej na terminalach komputerowych. Odległość ani mury po drodze nie odgrywają dużej roli, skoro ten słynny eksperyment przeprowadzany był z samochodu stojącego na parkingu, a podglądane komputery znajdowały się w budynkach obok. Holender do “zaglądania” na monitory użył zmodyfikowanego odbiornika TV. Ten dość prosty sposób inwigilacji może być w sprzyjających warunkach wykorzystywany również obecnie, jednakże współcześnie stosowane metody są znacznie bardziej wyrafinowane, bazują bowiem na technikach cyfrowego przetwarzania sygnałów. Pomysł, na którym opierał się pokaz van Ecka, nie był zresztą nowy.

Możliwość pozyskiwania informacji z bezpiecznej odległości bez konieczności uzyskania bezpośredniego dostępu do urządzenia była i jest niewątpliwie niezwykle atrakcyjna dla wszystkich służb wywiadowczych. Pierwsze wzmianki o przedsięwzięciach, w których wykorzystywano by kanały ubocznego przenikania informacji, dotyczą okresu... pierwszej wojny światowej. Stosowane wówczas telefony i telegrafy łączono kablem jednożyłowym, a tor powrotny tworzono poprzez uziemianie urządzeń końcowych. Działania wojenne w tym okresie miały charakter raczej mało dynamiczny, a pozycje wrogich sobie wojsk znajdowały się dość blisko siebie, więc stosunkowo łatwo było podsłuchiwać rozmowy przeciwnika, wykorzystując na przykład umieszczone wzdłuż jego stanowisk, wbite w ziemię, metalowe pręty. Mówi się, że pozyskane w ten sposób informacje w znaczący sposób przyczyniły się do początkowych sukcesów frontowych armii niemieckiej.

Prawdopodobnie do wzrostu zainteresowania metodami infiltracji elektromagnetycznej przyczyniły się obserwacje amerykańskiego kryptologa Herberta Yardleya, który na początku dwudziestolecia międzywojennego, w trakcie prac prowadzonych na zlecenie armii USA, stwierdził, że ówczesne urządzenia wykorzystywane do przetwarzania informacji (w tym kryptograficzne) wytwarzają szereg niepożądanych sygnałów. Yardley odkrył, że owe sygnały mogą pomóc w poznaniu danych, przy okazji przetwarzania których powstały. Spostrzeżenia te przyczyniały się zarówno do rozwijania technik wywiadowczych, jak i opracowywania metod przeciwdziałania.

W okresie drugiej wojny światowej powszechne stało się ekranowanie generatorów lokalnych urządzeń odbiorczych instalowanych na okrętach w celu uniemożliwienia ich namierzania przez wrogie łodzie podwodne. W późnych latach 50. monitoring emisji wytwarzanej przez odbiorniki radiowe znajdujące się w radzieckiej ambasadzie w Londynie umożliwić miał angielskim służbom specjalnym rozpoznanie częstotliwości wykorzystywanych przez komunistycznych agentów. Aczkolwiek Rosjanie wiedzieli ponoć o istnieniu słynnego “tunelu berlińskiego” (podkopu biegnącego z Berlina Zachodniego pod stolicą NRD, wypełnionego aparaturą podsłuchową), to pozwalając mu funkcjonować przez prawie rok, prawdopodobnie przyczynili się do rozwoju programu Tempest. Amerykański wywiad korzystający z “tunelu berlińskiego” po analizie zapisów rozmów prowadzonych przez Rosjan zidentyfikować miał rzekomo sygnały wytwarzane przez podzespoły urządzeń kryptograficznych, co umożliwiło odkrycie zasad ich pracy. Choć więc falami elektromagnetycznymi służby specjalne interesowały się od dawna, popularność tej problematyki wzrosła znacznie w połowie lat osiemdziesiątych, po ukazaniu się artykułu Wima van Ecka.

Z ogólnodostępnych źródeł wynika, że prekursorem zorganizowanych na szeroką skalę badań fenomenu elektromagnetycznego przenikania informacji były Stany Zjednoczone. W latach 50. ubiegłego stulecia działania obejmujące poszukiwanie efektywnych sposobów przeciwdziałania tego typu infiltracji skupiono tam w ramach jednego programu oznaczonego kryptonimem Tempest (ang. “burza”). Program ten, rozwijany przez ponad pół wieku pod egidą słynnej i supertajnej NSA (National Security Agency), w większej części nadal pozostaje tajny.

Badania podobne do amerykańskiej “Burzy” podejmowano również w innych krajach, zarówno po zachodniej, jak i wschodniej stronie Żelaznej Kurtyny, w tym też w Polsce. Po wejściu Polski do UE i NATO zmodyfikowano procedury przetwarzania tajnych materiałów, czego efektem jest m.in. nowa ustawa o ochronie informacji niejawnych (Dz.U. nr 11, poz. 95, 1999 r.), której rozdział 10. poświęcony został bezpieczeństwu systemów i sieci teleinformatycznych. W rozdziale tym po raz pierwszy głośno i wyraźnie mówi się o konieczności wykorzystywania m.in. środków ochrony elektromagnetycznej w przypadku działań związanych z przetwarzaniem informacji stanowiących tajemnicę państwową.

Duszy plebejskiej stale towarzyszy uczucie, że ręka, która ochrania może ją udusić.

Mikołaj Gomez Davilla

Echelon i Carnivore To nie film S-F, to prawdaPrzeciętny człowiek jest w stanie w jednym momencie przyjąć maksymalnie do 7 różnego typu informacji (świadomie lub podświadomie). W tej dziedzinie zdecydowanie lepsze SA kobiety (teorii na ten temat jest wiele i nie będę tutaj tego analizować, wystarczy znaleźć odpowiednie materiały w sieci). Podobnie jest z wykonywaniem czynności, tu również przodują kobiety. Przeciętny człowiek (zarówno kobieta jak i mężczyzna) z reguły są w stanie skupić się tylko na 1 maksymalnie 2 czynnościach jednocześnie. Wystarczy sprawdzić nasz refleks podczas rozmowy telefonicznej w trakcie jazdy samochodem.

Nic dziwnego, że przeciętnemu człowiekowi, który w dodatku nie ma wiedzy technicznej, a jego znajomość systemów informatycznych sprowadza się do obsługi programów typu edytor tekstu w systemie Windows, nie mieści się w głowie to, co za chwilę Ci przekażę. Niestety, nie jest to film S-F.

Każdy, kto ma jakiekolwiek pojęcie o działaniu światowej sieci Internet wie, że anonimowość użytkownika, który z niej korzysta to czysta fikcja. Każdy nasz ruch może być prześledzony, niezależnie od tego, czy korzystamy ze zmiennych IP, maskowania, szyfrowania, NAT czy innych wynalazków. Żadna technologia związana z internetem nie jest udostępniana użytkownikom publicznym, jeśli nie może być złamana przez systemy zabezpieczeń używane przez służby specjalne. Wystarczy przypomnieć sobie program SecureSSH, który umożliwiał bezpieczne połączenie protokołem SSH. Do 2001 roku nie był dopuszczony do sprzedaży, a nawet eksportu poza teren USA ze względów bezpieczeństwa. Obawiano się wycieku kodu, który mógłby być złamany i wykorzystany do komunikacji, której nie mogłyby odczytać służby specjalne. Akcja blokady jak podejrzewa się w weielu źródłach była dziełem NSA (Nasional Security Agency). Po 2001 roku, kiedy opracowano doskonalsze metody szyfrowania danych, program został „uwolniony”. Dowodzi to tylko tego, że uwolnienie nastąpiło w momencie opracowania przez NSA metod podsłuchu informacji przekazywanych za jego pomocą.

Każdy może być podsłuchany, a najbardziej rozbudowanym systemem podsłuchowym Świata, jaki znamy obecnie jest system Echelon.

Pierwszy raz zetknąłem się z informacjami na temat działania systemu Echelon w połowie lat 90-tych. Kiedy informacje na jego temat były w formie szczątkowej. Właściwie jakakolwiek próba uzyskania informacji na jego temat spełzała na niczym, a każdy patrzył na mnie jak na wariata, kiedy wyjaśniałem, jakie są prawdodpodobne możliwości tego systemu (zwłaszcza, że byłem dużo młodszym czowiekiem niż teraz). W tamtych czasach nie było żadnych potwierdzonych informacji na jego temat, a rozpowszechnianie istnienia systemu Echelon szufladkowało człowieka jako szaleńca ogarniętego teoriami spiskowymi. Dzisiaj nikt już tak nie mówi, ale minęło ponad 10 lat. Ciekawe co istnieje teraz i kiedy się o tym dowiemy.

Czy podstawie zgromadzonej już teraz wiedzy jesteśmy w stanie wyobrazić sobie, z czym mamy do czynienia ?

Zanim jednak przejdziemy do konkretów warto zapamiętać, że pierwsze oficjalne wzmianki o istnieniu systemu Echelon pojawiły się dopiero w sierpniu 1988 roku (pierwsza wzmianka o sieci podsłuchowej pojawiła się w piśmie „New Statesman” 7 sierpnia 1980r.). Na początku 1988 roku Margaret Newsham, zatrudniona wcześniej w należącej do NSA bazie Menwith Hill, położonej w pobliżu Harrogate na północy Anglii (hrabstwo Yorkshire), zdecydowała się złożyć w Kongresie skargę na szereg nadużyć, jakie jej zdaniem miały miejsce w tajnych amerykańskich projektach wywiadowczych. Przy tej okazji wyszło na jaw, że w bazie owej podsłuchiwano rozmowy telefoniczne jednego z amerykańskich senatorów, podczas gdy prawo amerykańskie wyraźnie zabrania agencjom wywiadowczym tego państwa szpiegowania swoich własnych obywateli.

Sprawą zainteresował się wtedy brytyjski dziennikarz Duncan Campbell, który w efekcie przeprowadzonego przez siebie “śledztwa” opublikował 12 sierpnia w czasopiśmie New Statesman artykuł mówiący o tym, co właściwie dzieje się w bazie Menwith Hill.

Krótko na temat baz systemu EchelonBaza NSA w Menwith Hill posiada 22 terminale satelitarne i zajmuje ponad 4.9 akrów powierzchni, będąc największą w sieci UKUSA. Odegrała znaczącą rolę w wojnie w Zatoce Perskiej, przechwytując komunikację mikrofalową oraz służąc jako stacja przekaźnikowa satelitów szpiegowskich. Komunikacja mikrofalowa to na przykład komunikacja za pomocą przenośnych radiotelefonów, walkie-talkie, CB.

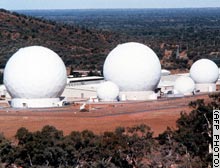

Innymi stacjami są Pine Gap, niedaleko Alice Springs w środkowej Australii, obsługiwana przez CIA, stacja Bad Aibling w Niemczech w Bawarii, obok siedziby BND (baza została zlikwidowana w 2004). Jej zadaniem było przechwytywanie wiadomości z kanałów telekomunikacji w Niemczech i przyległej części Europy. Baza ta została przeniesiona bardziej w centrum Niemiec do Griesheimu w okolicy Darmstadtu. I wiele innych.

Innymi stacjami są Pine Gap, niedaleko Alice Springs w środkowej Australii, obsługiwana przez CIA, stacja Bad Aibling w Niemczech w Bawarii, obok siedziby BND (baza została zlikwidowana w 2004). Jej zadaniem było przechwytywanie wiadomości z kanałów telekomunikacji w Niemczech i przyległej części Europy. Baza ta została przeniesiona bardziej w centrum Niemiec do Griesheimu w okolicy Darmstadtu. I wiele innych.

10 spośród nich łączy system Echelon ze wszystkimi głównymi sieciami komunikacyjnymi świata. Każda z nich ma oddzielny superkomputer do analiz za pomocą systemu Dictionary, o którym napiszę w dalszej części.

We wczesnych latach 90-tych przeciwnicy stacji w Manwith Hill weszli w posiadanie sporej ilości wewnętrznych dokumentów stacji. Informacje w nich zawarte mówiły o systemie NSA nazwanym

„Platform”. Integracja systemów UKUSA w sieć Echelon zapoczątkowała prawdodpodobnie powstanie tego systemu we wczesnych latach 80-tych. James Bamford napisał wtedy o systemie „Platform”, że „łączy on 52 systemy komputerowe na całym świecie. Nadrzędnym systemem takiej sieci oraz punktem docelowym przesyłanych danych wg informacji z dokumentów stacji Menwith Hill jest główna siedziba NSA w Fort Meade. „Jedną z organizacji wchodzących w skład systemu „Platform” ma być brytyjska SIGINT.

Ale po kolei...

Poniżej przedstawię informacje, jakie mnie się udało uzyskać, korzystając z opracowań dostępnych m.in. w sieci.

Historia systemu Echelon sięga roku 1947, kiedy NSA oraz jej brytyjski odpowiednik GCHQ (Government Communication Headquarters) zawarło porozumienie UKUSA o utworzeniu wspólnie projektu o kodowej nazwie „Echelon”. Zostało ono rozszerzone później o 3 kolejne kraje (Kanada, Australia i Nowa Zelandia) . W założeniu miała to być ogólnoświatowa sieć podsłuchowa, której istnienie było podyktowane oficjalnie powojenną kontrolą informacji w celu nie dopuszczenia do powtórzenia się następnej wojny (kontrola wrogich zamiarów, głównie Rosji, Japonii i państw byłego Układu Warszawskiego). Początkowo głównym celem systemu był monitoring transmisji wojskowych. Z biegiem czasu jak się później okaże sieć ta przekształciła się w giganta, który może podsłuchać niemal wszystko.

Założeniem systemu Echelon do dzisiaj jest podsłuchiwanie hurtowe wszystkich dostępnych transmisji, filtrowanie ich pod względem kontekstowym i występowania słów-kluczy, oraz nagrywania i przekazywania raportów dotyczących tych informacji do odpowiednich komórek wywiadowczych w celu dalszego przetwarzania (nie związanego już bezpośrednio z działaniem systemu).

Aby zrealizować ten cel stworzona została najprawdopodobniej we wczesnych latach 70-tych sieć systemu Echelon (działająca równolegle do sieci Internet, ale od niej odseparowana w postaci intranetu opartego o protokół TCP/IP), która w latach 80-tych wg informacji Campbell’a była rozleglejszy od ówczesnego Internetu. Pierwotna wersja systemu analizowała dane przechwycone przez dwie istniejące w tym czasie stacje nasłuchowe transmisji przesyłanych przez system satelitów telekomunikacyjnych Intelsat (jedna znajdowała się w miejscowości Morwenstow w Anglii, druga w Yakima na północnym zachodzie USA). Skuteczność systemu była tak duża, że zdecydowano o rozbudowie systemu, a rozbudowa ta jest dokonywana na bieżąoco wraz z pojwieniem się nowych środków łączności i technologii. Przypuszcza się, że obecnie system Echelon jest zdolny do przechwytywania i analizowania większości (według niektórych nawet 90%) połączeń telefonicznych, teleksowych, faksowych i internetowych w ruchu międzynarodowym, a być może w niektórych państwach także połączeń krajowych. Dotyczy to także Polski.

Wracając do wspomnianego artykułu z 1988 roku. Wbrew zamierzeniom autora nie wywołał on takiego rozgłosu, jaki miał wywołać. Żadne stacje medialne nie podjęły tematu. Nad powodem takiego zachowania można by się zastanowić (polecenia odgórne, potraktowanie autora jako „szaleńca” z manią prześladowczą, czy wreszcie działania służb specjalnych), ale nie ma to teraz po 20 latach tak naprawdę znaczenia, ponieważ cisza na temat tego systemu została przerwana na 8 lat, aż do publikacji w 1996 roku przez nowozelandzkiego dziennikarza Nicky’ego Hager’a książki pod tytułem „Secret Power: New Zealand’s Role in the International Spy Network”, która do dnia dzisiejszego jest najbardziej wnikliwą analizą tego tematu.

Uzupełnieniem książki Hager’a jest raport Campbell’a z roku 2000 opracowany na zlecenie Parlamentu Europejskiego pod nazwą „Interception Capabilities 2000” (który jest dostępny w internecie po adresem http://www.cyber-rights.org/interception/stoa/ic2kreport.htm), w którym wyszczególnione są techniczne możliwości podsłuchu różnych kanałów łaczności.

16 grudnia 1997 roku Simon Davies w raporcie „Assessing the Technologies of Political Control” dla Komisji Europejskiej pisze o tym, że „USA korzystają z ogólnoświatowej sieci, która może służyć do szpiegowania obywateli Unii Europejskiej”. Mówi on również o tym, że w Wielkiej Brytanii istnieje jedna z głównych baz tego systemu podsłuchująca zarówno obywateli UK, jak i Europy. Jest to również pierwsze oficjalne potwierdzenie istnienia systemu Echelon na forum ogólnoświatowym. Większość organizacji wywiadowczych korzysta z metod szpiegowskich oraz podsłuchów. Służby wielu krajów korzystają z urządzeń instalowanych w centralach telefonicznych (afera Watergate w 1972r. podczas której wykryto, że NSA prowadziła podsłuch tego typu od 1945 roku), na routerach szkieletowych internetu, repeaterach światłowodowych i tym podobnych. Różnica pomiędzy nimi polega na tym, że w standardowych działaniach wywiadowczych podsłuchiwane są konkretne osoby, grupy osób lub firmy czy organizacje, natomiast w przypadku projektu Echelon podsłuchuje się wszystkich hurtowo, po czym z tego zbioru informacji dopiero filtruje się te, które nas bezpośrednio interesują. Wynikiem takiej filozofii działania jest podsłuch wszystkich w każdym momencie.

Przypuszczalna struktura i procedury działania.Sercem systemu Echelon jest podsystem Dictionary, przeszukuje on pozyskane przez system dane w poszukiwaniu zdefiniowanych odpowiednich słów kluczowych. Na początku system ten opierał się tylko na analizie danych tekstowych (faksy, pliki tekstowe), ale wraz z rozwojem technologii i włączaniem do systemu Echelon coraz to doskonalszych komputerów, doszła do tego bieżąca analiza danych szyfrowanych oraz głosowych. Wyszukiwanie danych wspomagane jest systemami sztucznej inteligencji. Potwierdzone jest użycie systemów MEMEX w pierwszych wersjach systemu, oraz systemów na nim wzorowanych w późniejszych czasach. Przedstawicielem takiego systemu jest stworzony przez Microsoft „MyLifeBits” kontekstowo wiążący ze sobą informacje, projektu Gordona Bella z Microsoft Research, opartego na bazie danych cyfrowego zbioru fotografii, dokumentów, kontaktów z innymi, możliwych do adnotowania, zindeksowania i przeszukiwania. Ten rozwijany stale projekt próbuje uchwycić w jak najbardziej zautomatyzowany sposób życiowe doświadczenia, do łatwego późniejszego wykorzystania.

Jeżeli ktoreś ze zdefiniowanych przez agencje wywiadowcze słów kluczowych zostanie znalezione, cała wiadomość, w którym występowało (teleks, faks, e-mail) opatrywana jest odpowiednim kodem, zawierającym datę, czas i miejsce przechwycenia oraz rodzaj kanału telekomunikacyjnego, którym wiadomość była przesyłana (publiczny, dyplomatyczny, wojskowy itp.) i przekazywana do dalszej analizy przez ludzi w poszczególnych komórkach.

Wewnątrz organizacji wywiadowczych dodatkowo istnieją nazwy kodowe na poszczególne procedury działań monitorujących. W przypadku GCHQ na przykład kodowe nazwy określające podsłuch rozmów telefonicznych to „Mantis”, natomiast faksów i teleksów: „Mayfly”.

Każdy z analityków agencji wywiadowczych przyporządkowany jest do odpowiedniej kategorii analitycznej w ramach komórki. Codziennie z pozyskanych informacji tworzony jest automatycznie raport, który przesyłany jest odpowiednim komórkom wywiadowczym wraz z zawartością w postaci paczki danych opatrzonej czterocyfrowym kodem kategorii, który przyporządkowany jest konkretnym obszarom inwigilacyjnym danej komórki. Przykładowo kod 2234 może w jednej z komórek oznaczać podsłuch rozmów telefonicznych RPA, podczas gdy w innej komórce może to być kod 4323, lub nie być wogóle przyporządkowany. Dzięki temu kod czterocyfrowy wystarcza do obsługi wszystkich kategorii podsłuchowych, choć być może w chwili obecnej już nie wystarcza, ponieważ dane te pochodzą z opracowania Hager’a sprzed kilku lat. Pracownicy agencji otrzymują taki raport, następnie po analizie podejmują decyzje, co dalej robić z pozyskanymi informacjami.

Dodatkowymi funkcjami systemu Dictionary jest informacja sterowana zdarzeniami. Polega ona na tym, że dana komórka definiując słowa kluczowe (lub ich dowolne kombinacje określane np: wyrażeniami logicznymi) wyszukiwania może w systemie pozostawić alarm reagujący na wystąpienie danego tekstu spełniającego zadane kryteria. W momencie jego odnalezienia, system automatycznie powiadamia o tym fakcie odpowiednią komórkę i przesyła do niej pełną zarejestrowaną wiadomość wraz z ewentualnymi innymi powiązanymi z nią danymi. Mechanizm ten służy do obsługi zdarzeń o wysokim priorytecie.

Korzystając z sieci Echelon, każda z 5 agencji może zadawać pytania o zdefiniowane przez nią kategorie informacji oraz odbierać przechwycone wiadomości z każdej stacji Echelona na świecie. Komputery wykonujące przeszukiwanie działają przy tym równocześnie wirtualizując wyszukiwanie dla każdej agencji z osobna - każda z nich, niezależnie od pozostałych, może zdalnie wprowadzać własne słowa kluczowe do wyszukiwania, a wyszukany materiał jest bezpośrednio przesyłany do “zamawiającej” go agencji z pominięciem lokalnego personelu obsługującego system.

Teoretycznie więc w systemie Echelon informacje wywiadowcze poszczególnych agencji są od siebie odseparowane. Zastanawia jednak fakt, że wszystkie urządzenia i oprogramowanie dostarczane jest przez NSA, co może rodzić podejrzenia, że zaimplementowane są w nich luki, pozwalające tej agencji kontrolę informacji innych komórek wywiadowczych.

O skali działania systemu może świadczyć wypowiedź szefa NSA zamieszczona w raporcie Campbell’a “Interception Capabilities 2000”: “tylko jeden (nie wymieniony z nazwy) system podsłuchowy może dostarczyć miliona wiadomości w ciągu pół godziny. Z tego miliona filtry pozostawiają jedynie 6500; tylko 1000 spełnia kryteria przekazania do dalszej obróbki; analitycy wybierają dziesięć, z których wytwarzany jest zaledwie jeden raport - takie są typowe statystyki [...]”. Ale nie zapominajmy o jednym: te dane pochodzą maksymalnie z roku 1999 !!! Od tamtego czasu liczba choćby nawet użytkowników telefonii komórkowej w Europie wzrosła kilkunastokrotnie.

Rozwój Internetu spowodował konieczność podsłuchiwania również tego medium. Najbardziej znanym przypadkiem jest ujawnienie w 1995 roku faktu instalacji w głównych węzłach amerykańskiego Internetu MCI, MAE-East i MAE-West narzędzi typu sniffer. O ile teraz cześć ruchu omija te węzły, o tyle w tamtych czasach taki fakt oznaczał możliwość podsłuchu większości ruchu internetowego na Świecie.

Czy w Polsce też jesteśmy podsłuchiwani ? Co mogłoby świadczyć o tym, że nie jesteśmy ? Jak pewnie większość osób orientuje się, obecnie 90% informacji wcale nie musi być podsuchiwana, ponieważ znajduje się na stronach WWW w postaci jawnej. Coraz więcej osób korzysta z serwisów zakładających i prowadzących blogi, systemów CRM, systemów tworzenia własnych stron internetowych pisanych z reguły w językach PHP czy ASP. Podsłuchanie tych informacji nie wymaga zbyt wielkich nakładów ze strony agencji rządowych. Ogólnie wiadomo, że brytyjska agencja DERA (Defense Evaluation and Research Agency) posiada laboratoria z dyskami przechowującymi wszystkie wiadomości z grup news oaz usenetu z 90 ostatnich dni. Z informacji pojawiających się o systemie Echelon głównymi celami analizy są serwisy o tematyce wolnościowej, anarchistycznej, oraz wszelkich organizacji pozarządowych. Dodatkowo do zbierania informacji system Echelon posiada wyspecjalizowane roboty internetowe działające na wzór tych z wyszukiwarek internetowych, które przeszukują strony WWW w poszukiwaniu odpowiednich słów kluczowych na zasadzie opisanej w przypadku systemu Dictionary.

Polska i EchelonKilka lat temu tematem bardzo na czasie była kwestia tarczy antyrakietowej, której elementy miałyby być zainstalowane na terenie Polski. Z nieoficjalnych informacji wynika, że oprócz instalacji radaru tarczy, oraz innych jej podzespołów, baza w której znajdowałby się ten sprzęt miałaby służyć również jako kolejna baza systemu Echelon na terenie Europy Środkowo-Wschodniej. Byłby to świetny przyczółek dla systemu Echelon do podsłuchiwania wszelkiego rodzaju transmisji radiowych na tym terenie. Nie trzeba długo myśleć, by zrozumieć, że większość monitorowanego ruchu stanowiłyby transmisje z terenu Rosji i krajów nadbałtyckich oraz dawnego ZSRR, Jugosławii. Na zdjęciach przedstawiających bazy systemu Echelon widać wielkie sferyczne obiekty, zawierające sprzęt. Oficjalnie w przypadku bazy tarczy antyrakietowej zawiera on ogromnej mocy radar, ale w takiej wieży może być zamontowane dużo sprzętu mogącego mieć inne przeznaczenie. Nie trzeba dodawać, że do bazy tych wstęp mają jedynie nieliczni najwyższej rangi oficerowie.

UE i EchelonBadania Unii Europejskiej potwierdziły (jak również były dyrektor centrali wywiadu DCI, tym samym szef CIA Robert James Woolsey w swoim artykule z 17 marca 2000 w Wall Street Journal), że Echelon miał swój duży udział w wygranych przez Boeing kontraktach przeciwko europejskiemu Airbusowi. Dla ułatwienia pracy szpiegowskiej systemu Echelon, władze amerykańskie obłożyły embargiem niektóre techniki szyfrowania, np. PGP. Podobną sieć zbudował Związek Radziecki, a jej ocalałe resztki przejął wywiad rosyjski. W Wietnamie w bazie Can Ran były instalacje tej sieci. Również na Kubie był podobny obiekt. Swoje obiekty ( na mniejszą niż amerykańska skalę) wywiadu elektronicznego zbudowała również Francja.

Czemu o tych systemach jest tak cicho ? Czemu nikt nie podnosi krzyku o naruszanie wolności osobistych ? Dlaczego ? Może dlatego, że coraz częściej pojawiają się informacje, iż Unia Europejska pracuje nad własną wersją systemu analogicznego do systemu Echelon, służącego do podsłuchiwania własnych obywateli.

Carnivore (DCS1000)Carnivore jest systemem stworzonym przez FBI w celu monitorowania komunikacji elektronicznej (email, WWW, itp). Pierwotny projekt Carnivore zakładał instalację oprogramowania i sprzętu u providerów internetu. Dane gromadzone miały byc na przenośnych, szyfrowanych dyskach. Dane te dostępne mają być przez policję, FBI, sądy. Generalnie działanie systemu można skonfigurować w ten sposób, że zostanie przechwycony cały ruch w monitorowanej sieci. Podobieństwo do działania systemu Echelon widać na pierwszy rzut oka: podsłuchiwany jest cały ruch sieciowy, nawet nie związany bezpośrednio z prowadzonym śledztwem.

Jeden z dokumentów uzyskanych przez EPIC (Electronic Privacy Information Center), datowany na 5 czerwca 2000, informuje o testach przeprowadzonych na systemie Carnivore w wersji 1.3.4, która jest prawdodpodobnie nadal używana. Konkluzja raportu jest następująca: „Carnivore jest w stanie zarchiwizować cały nie przefiltrowany ruch.”

Aby skutecznie wykorzystać system Carnivore po 2001 roku uchwalono w USA „Foreign Intelligence Surveillance Act” (FISA), prawo, które tworzy sądy nadające uprawnienia do podsłuchiwania obywateli m.in. za pomocą systemu Carnivore. Obecnie maksymalny czas podsłuchu może wynosić 45-90 dni, ale planowane jest rozszerzenie pozwoleń do roku. Korzystając z tego prawa prokuratorzy mają dostęp do danych każdego przedsiębiorstwa, kart kredytowych oraz uzyskują dostęp do sieci przedsiębiorstw na prawach administracyjnych bez zgody sędziów prowadzących dane postępowania. Każdy obywatel podejrzany o terroryzm może być aresztowany w każdym momencie przez służby federalne bez podania przyczyn. W tym celu również stworzony został pakiet ustaw noszący nazwę „Homeland Security” oraz „Patriot Act” (który de facto przegłosowany został w tempie ekspresowym i co najbardziej szokujące: bez zapoznania się z nim przez kongresmanów !!!). W ten sposób „oficjalnie” zlikwidowano wszelkie ograniczenia w walce z terroryzmem na terenie USA.

Również na podstawie tego prawa nikt nie może posiadać w domu środków chemicznych, które nie są przez agencje federalne zatwierdzone jako te o wykorzystaniu w „celach pokojowych”, a każdemu podejrzanemu można pobrać próbki DNA bez jego zgody.

SpyWareSpyware jest o oprogramowanie, które z reguły instalowane jest na stacji użytkownika pod pozorem instalacji programów użytkowych. Po instalacji oprogramowanie takie ukrywa się w systemie, monitorując wszystkie zdarzenia takie jak naciśnięte przyciski, wpisywane hasła, odwiedzane adresy. Oprogramowanie to również zbiera dane użytkownika komputera i przekazuje je do zewnętrznego systemu. Za pomoca oprogramowania SpyWare i Adware (reklamowe) możliwa jest również kontrola zdalnej, zainfekowanej maszyny.

W chwili obecnej SpyWare używa się do wykradania informacji i przestępstw. W Niemczech według oficjalnych informacji policja stara się w od 2008 roku o uchwalenie prawa umożliwiającego na stosowanie przez służby oprogramowania SpyWare do śledzenia działalności internetowej podejrzanych osób. Krótko mówiąc: przestępstwo w majestacie prawa.

Carnivore (DCS1000), Echelon i satelityOd wielu lat o systemie Echelon mówi się nieoficjalnie. Kiedy w 1996 roku zacząłem rozmawiać z ludźmi na ten temat każdy machał ręką i mówił, że to bujda, że się tak nie da. Czas jednak zweryfikował moje słowa pozytywnie. Teraz już w większości filmów nawet (np.: „Ultimatum Bourne’a”, serialach o tematyce szpiegowskiej i sensacyjnej) jawnie wymienia się go z nazwy. Jest to ewidentny poza ustaleniami parlamentu europejskiego w tym zakresie jawny dowód na to, że taki system nie tylko działa i istnieje, ale też na to, że informacje te były prawdziwe, a ich ilość sprawiła, że system ten nie może już dłużej pozostać uznawany jako „nieistniejący” przez służby specjalne, które już teraz jawnie przyznają o jego istnieniu, choć w latach 90-tych stanowczo temu zaprzeczały.

Jeśli więc myślisz, że film „Wróg publiczny” to science-fiction, ocknij się. W kosmos patrzy tylko jeden teleskop na orbicie (Hubble’a), na Ziemię patrzy ich setki, niektóre o takiej rozdzielczości, że umożliwiają odczytać godzinę na zegarku. Niemożliwe ? Jeśli zdjęcia z map Google’a pochodzą sprzed ponad 10 lat i widać na nich pojedyncze auta, a zdjęcia są udostępnione publicznie, dziś już odczytanie godziny z zegarka, podsłuch przez ściany, podsłuch satelitarny przez sufit domu, satelitarne zdjęcia termowizyjne wnętrz budynków nie stanowią żadnej przeszkody (a są dowody na to, że takie technologie są już w powszechnym użyciu).

Wystarczy tylko przytoczyć pewną informację z 19 lutego 2008 („FBI: nielegalna kontrola poczty e-mail” portal Interia.pl). FBI przyznało nie po raz pierwszy, że zbierane były informacje nie tylko o jednym podejżanym użytkowniku, ale o wszystkich użytkownikach wybranej domeny.

Według informacji podanych przez dziennik “New York Times”, FBI skasowało dane pochodzące od kilkuset albo nawet kilku tysięcy osób. W wypowiedzi dla gazety jeden z pracowników Biura ujawnił, że tego typu nielegalne ingerencje w prywatną sferę obywateli zdarzają się od czasu do czasu. Wprawdzie nie dzieje się to co tydzień, ale nie są to też odosobnione przypadki.

Amerykański Kongres debatuje obecnie nad nowelizacją FISA. W burzliwej debacie prezydent George W. Bush i senat optują za tym, aby osoby prywatne, pomagające władzom w śledzeniu i podsłuchiwaniu podejrzanych, nie podlegały karom za taką działalność. W senackiej propozycji planowanej nowelizacji brakuje ponadto zobowiązania służb do usuwania danych, w których posiadanie weszły one w wyniku takich pomyłek, jak opisana powyżej. EFF otrzymała dokument w ramach skargi przeciwko wcześniej ujawnionym nadużyciom uprawnień przez FBI tłumaczonych walką z terroryzmem.

Czas się obudzić.

Główne służby zrzeszone w sieci UKUSA:

- Australia: DSD - Defense Signals Directorate

- Canada: CSE - Communications Security Establishment

- New Zealand: GCSB - New Zealand’s Government Communications Security Bureau

- UK: GCHQ - Government Communications Head Quarters

- USA: NSA - National Security Agency

Chyba mało jest na Świecie osób, które nie zetknęły się z nazwą firmy Google Inc. Najpierw garść informacji o tym już informatycznym gigancie (źródło: Wikipedia). Firma została założona w 1998 roku (jedynie 12 lat temu ) przez dwóch doktorantów Uniwersytetu Stanforda, Larry’ego Page’a i Sergeya Brina. Opracowali oni nowatorską metodę analizy powiązań hipertekstowych - algorytm BackRub, potem przemianowany na PageRank - którą wykorzystali w swoim prototypie wyszukiwarki internetowej. Firma przetrwała załamanie rynku dot-comów i rozwijała się od tego czasu dzięki wsparciu prywatnych inwestorów. W roku 2004 spółka weszła na amerykańską giełdę, i od tej chwili doszło do znacznego przyspieszenia jej ekspansji, zakupu serwisów YouTube, Writely i przejęcia kilku innych mniejszych firm.

Obecnie Google zatrudnia ponad 12,000 pracowników w kilkunastu krajach, wykazuje przychody na poziomie 10 miliardów i zyski rzędu 3 miliardów dolarów rocznie. Korporacja znana jest ze swobodnego klimatu pracy, nietypowych przywilejów dla pracowników oraz zasady biznesowej don’t be evil (nie czyń złego). W rankingu magazynu Fortune, firma zajmuje obecnie pierwsze miejsce w rankingu najlepszych pracodawców.

Główna siedziba firmy mieści się w Mountain View, hrabstwo Santa Clara, w Kalifornii, w USA, na terenie wcześniej należącym do firmy SGI (Silicon Graphics). W Polsce tworzone jest centrum badawczo-rozwojowe w Krakowie oraz centrum innowacji we Wrocławiu, funkcjonuje także niewielkie biuro w Warszawie

Najbardziej znanymi usługami firmy są internetowa wyszukiwarka Google oraz serwisy reklamowe AdWords oraz AdSense, które stanowią główne źródło dochodów firmy. Do innych zaliczają się między innymi popularna poczta Gmail, serwisy Google Maps i Google Earth oraz aplikacja Google Desktop. Firma znana jest z tajemniczości dotyczącej planowanych w przyszłości usług, ale według deklaracji samych założycieli, dotyczą one nawet tak odległych zagadnień, jak sztuczna inteligencja na wielką skalę.

Dzięki unikaniu wielu dyskusyjnych praktyk biznesowych stosowanych przez konkurencję, na przykład odmowy odpłatnego pozycjonowania stron na liście wyników wyszukiwania oraz deklarowanej woli walki o prywatność swoich klientów, która posunęła się nawet do wygranego sporu z rządem Stanów Zjednoczonych o nakazy sądowe, Google cieszy się stosunkowo pozytywnym wizerunkiem w mediach. Niektóre z praktyk stosowanych przez firmę stały się jednak powodem kontrowersji.

Jednym z najgłośniejszych oskarżeń pod adresem firmy był zarzut wspierania cenzury w Internecie. Google, wraz z innymi dużymi firmami z branży IT, podporządkowało się ograniczeniom narzucanym przez rząd chiński, w zamian za możliwość dostępu do tego rynku. Ograniczenia te sprowadzają się do blokowania dostępu do niepożądanych stron dla obywateli Chin (np. związanych z protestami na placu Tiananmen w 1989 roku, stron wspierających ruchy niepodległościowe w Tybecie czy Tajwanie itp.). Działania te są interpretowane przez niektórych aktywistów jako rażąco sprzeczne z zasadą „don’t be evil”.

Innym częstym zarzutem pod adresem Google była wieloznaczna polityka prywatności, która nie podawała żadnych ograniczeń dotyczących tego, jak długo firma przechowywać będzie zapytania użytkowników i stosowanie ciasteczek do powiązania ze sobą kolejnych wizyt danej osoby. W roku 2007 firma wyeliminowała kontrowersyjne zapisy.

Jak działają roboty Google’a i co to jest PageRank ?(źródło: art. Piotra Rupika, Chip 07/2004)

Przeciętnie użytkownik zwraca uwagę tylko na pierwsze dziesięć odsyłaczy, pomijając pozostałe. Właśnie dlatego tak ważne jest, żeby informacja, do której chcemy dotrzeć, pojawiała się jako pierwsza, a dodatkowo żeby była to informacja dla nas wartościowa. Tutaj pojawia się odkrywcza myśl twórców Google’a. Zauważyli oni mianowicie, że o tym, czy dana strona jest cenna oraz czy warto ją promować, świadczą m.in. odsyłacze prowadzące do niej z innych stron WWW.

W ten sposób stworzyli algorytm PageRank, który nadawał odpowiedni priorytet wynikom wyszukiwania. Im więcej odnośników do danego dokumentu istnieje w Internecie, tym wyższy priorytet on otrzyma. PageRank dla strony

A można obliczyć, stosując następujący wzór:

PR(A) = (1-d) + d (PR(T1)/C(T1) + ... + PR(Tn)/C(Tn))

Zakładamy, że do pliku A prowadzą odsyłacze ze stron od T1 do Tn, d to współczynnik, który może przyjmować wartości od 0 do 1, zazwyczaj ustawiany jest na 0,85, a C(A) to liczba odnośników prowadzących z dokumentu A. Skąd wziąć wartości PR dla stron składowych? Gdybyśmy chcieli je obliczyć, otrzymamy układ 4,3 mld równań z 4,3 mld niewiadomych. Jego rozwiązanie jest oczywiście niemożliwe. Dlatego nie da się precyzyjnie określić wartości PageRanku dla wszystkich dokumentów. Nie ma jednak takiej potrzeby. Internet bowiem cały czas się zmienia. Problem rozwiązano następująco: na początku wszystkim dokumentom nadano identyczne wartości PR, później na tej podstawie obliczono współczynniki i... zaczęto obliczanie od nowa. W ten krokowy sposób można uzyskać współczynniki bliskie rzeczywistości.

Większość systemu została napisana w C lub C++ i działa na komputerach wyposażonych w system Linux. Roboty (crawlers) mają za zadanie pobierać strony WWW, których adres otrzymują od Serwera URL. Następnie skopiowane już pliki zostają skompresowane i wysłane do magazynu dokumentów (StoreServer). Każdy zbiór ma przydzielony unikatowy numer ID. Funkcje indeksowania i sortowania są wykonywane przez Indexer oraz Sorter. Pierwszy moduł pobiera dane z przechowalni, dekompresuje zapisane tam dokumenty i przetwarza je. Każdy plik jest przekształcany w rekordy nazywane trafieniami (hits). Znajdują się w nich: słowo, jego pozycja w dokumencie i rozmiar fontu.

Tak utworzone rekordy Indexer umieszcza w cylindrach. Drugim ważnym zadaniem wykonywanym przez Indexer jest przetwarzanie wszystkich odnośników występujących na pobranych przez Szperacza stronach i zapisywanie ich do Kotwicy. Znajdujące się tam dane zawierają informację, dokąd i skąd prowadzi odsyłacz, oraz opis, który przy nim występuje.

URL Resolver czyta rekordy z Kotwic, zamienia względne adresy URL na absolutne oraz nadaje im ID. Powiązane w ten sposób dane umieszczane są przez Indexera w Cylindrach i tam przechowywane. Dodatkowo URLresolver tworzy bazę odnośników (links), które są parą numerów ID. Służy ona właśnie do generowania rankingu stron (PageRank). Sorter pobiera Cylindry, które są ułożone rosnąco względem ID, i sortuje je ponownie, tworząc w ten sposób indeks odwrotny.

Najbliżej użytkownika jest Szukacz (Searcher), który jest uruchamiany przez serwer WWW, a następnie, korzystając z leksykonu utworzonego przez Indexer, odwrotnego indeksu oraz modułu wyliczającego PageRank odpowiada na zapytania użytkowników.

Potężnym wyzwaniem jest pobieranie stron, a Crawler jest najczulszym punktem w całym systemie Google’a. Jego zadaniem jest odwiedzanie setek tysięcy dokumentów. Szperacze są zazwyczaj uruchamiane po kilka jednocześnie, a każdy utrzymuje około 300 połączeń naraz. Z obsługą takiego ruchu nie radzą sobie serwery DNS. Dlatego każdy Szperacz dysponuje własną pamięcią DNS, dzięki czemu nie musi za każdym razem wysyłać zapytań do serwerów nazw. Pomimo szczegółowego opracowania systemu na etapie projektowania podczas pracy Szperaczy zdarzały się nieprzewidziane sytuacje, jak chociażby próba pobrania trwającej gry online, co generowało dużą ilość niepotrzebnych informacji.

Kluczem do sukcesu jest spowodowanie, żeby wyniki wyszukiwania były jak najbardziej zbliżone do oczekiwań użytkownika próbującego odnaleźć w Internecie potrzebną mu informację. Jak to osiągnąć? Weźmy najprostsze zapytanie, jakim jest pojedyncze słowo. Google najpierw tworzy listę dokumentów, w których ono zostało użyte. Wyraz może wystąpić w tytule, URL-u, treści strony zapisany małą czcionką, wytłuszczony itp. Każde z tych miejsc lub atrybutów ma przyznaną określoną wagę, co w powiązaniu z systemem PageRank daje ostateczny wynik i powoduje umieszczenie strony na odpowiednim miejscu w rezultatach szukania.

Sprzęt, na którym działa system Google, to nie jeden potężny serwer, a farma złożona z około 15 000 komputerów klasy PC [dane z roku 2002] (najprawdopodobniej największy w tej chwili system komputerowy tego typu na świecie). Całość pracuje z systemem Linux. Część tych maszyn zajmuje się pobieraniem stron WWW (aplikacja Crawler). Zwykle wygląda to tak, że na początku połączenie ze skanowanym serwisem nawiązuje jeden lub dwa roboty. Następnego dnia pojawia się ich 8 lub 9, a każdy Szperacz odwiedza około 8 stron na serwerze. Ponownie zjawiają się za około tydzień, później znikają na dłużej. Jednak pobrana strona nie pojawia się od razu w rezultatach wyszukiwania. Z reguły można ją tam znaleźć po około miesiącu od wizyty botów. Taki cykl nazywany jest przez fanów wyszukiwarki “Google Dance” i trwa właśnie około 30 dni - po tym czasie informacje w bazie Google’a zostają odświeżone.

Dlaczego Google jest niebezpieczne ?Austriaccy naukowcy z Uniwersytetu w Gratzu opublikowali w 2007 roku raport, w którym stwierdzają, że „Google w przyszłości może stanowić ogromne zagrożenie ekonomiczne”. Według uczonych koncern Google buduje obecnie monopol mogący w przyszłości godzić w światowy przepływ informacji. Według ich obliczeń 57 proc. z 61 mld zapytań wystukiwanych w internecie jest kontrolowanych przez tą właśnie firmę. W połączeniu z takimi narzędziami jak Gmail czy YouTube gigant Google jest w stanie zdobyć informację o każdej osobie korzystającej z tych serwisów. Zwrócono także uwagę na wiele poszlak wskazujących na powiązania internetowego monopolisty z Wikipedią.

Naukowcy alarmują, że odpowiednie kroki powinny zostać podjęte wobec koncernu już bardzo dawno temu. W raporcie sugerują wprowadzenie wyszukiwarek, nad którymi kuratelę sprawowałyby instytucję pożytku publicznego.

Firma Google w odpowiedzi na raport wydała oświadczenie, w którym stwierdza, że takie postrzeganie faktów jest efektem niedomówień, teorii spiskowych oraz opiera się na fundamentalnym niezrozumieniu ich produktów i usług.

Za pomocą GMail firma Google zbiera informacje o użytkownikach. Jedną z wykorzystywanych technologii jest adaptywna reklama. Nie eksponowanym mechanizmem tej reklamy jest analiza poczty (tak, Google czyta Twoje listy !). Aby to sprawdzić, wystarczy wysac listy o określonej treści, np motoryzacyjnej. Po pewnym czasie korzystając z Gogle’a zauważymy, że reklamy jakie się w nim pojawiają są o takiej samej treści. Zastanawialiście się kiedyś dlaczego ? Dokładnie to samo dzieje się w przypadku wyszukiwania stron o konkretnej tematyce. Aby to uzyskać, Google musi zarówno czytać maile, przechowywać informacje o wyszukiwaniach (Google, Froogle, Maps i innych), oraz korzystać z narzędzi analitycznych wiążących działania z użytkownikiem korzystającym z ich serwisów. Dodatkowo do listy narzędzi oferowanych przez Google dochodzą aplikacje, takie jak GoogleDesktop, czy GoogleSearchBar, które zainstalowane na komputerze użytkownika dodatkowo komunikują się z serwisami Google, przekazując im informacje na temat zasobów komputerów ich użytkowników.

Możliwości gromadzenia takiej ilości danych na temat użytkownika, w praktyce oznacza utratę jego prywatności (wszystko pczywiście przy założeniu, że korzystając z internetu używa on głównie narzędzi Google’a). Od tej chwili nietrudno już z wykorzystaniem odpowiednich narzędzi i posiadając tak ogromną bazę danych na temat użytkowników internetu przewidywać przykładowo: działania giełdowe, tendencje rynku, migracji, zmiany zainteresowań a być może i plany militarne. Tego nie trzeba sobie nawet sobie już nawet wyobrażać, ponieważ taka możliwość istnieje i jest realna przy tym zasobie informacji, jaki w chwili obecnej posiada Google. Odpowiednie osoby mogą na bazie tych danych nie tylko inwestować środki bez ryzyka, ale również tworzyć tendencje rynkowe.

Zadajmy więc sobie pytanie: czy korzyści z używania narzędzi Google’a są faktycznie większe niż możliwość zachowania naszej własnej prywatności ? Każdy powinien odpowiedzieć sobie na nie sam.

Aby samemu przekonać się o wielkości Google’a, wystarczy zauważyć, że jakiekolwiek wyszukiwanie w jakimkolwiek serwisie nosi znamię tej firmy „enchanced by Google”, co oznacza, że wyszukanie jakiejkolwiek treści w ramach takiego serwisu jest automatycznie raportowane do Google.

Na koniec prosta metoda sprawdzenia, ile informacji o nas zbiera Google. Zakładając konto gMail mamy możliwość korzystania z wielu innych zdobyczy takich jak kalendarz, wyszukiwanie obrazków, materiałów wideo. Każde wyszukiwanie, kliknięcie jest przypisywane do konta lub numeru IP. Zobacz na koncie gMail, co widnieje w historii. Znajdziesz tam: słowa kluczowe wyszukiwania stron, na co kliknąłeś, wyniki wyszikwania map. Okaże się, że jeśli korzystasz z Google odpowiednio często, mechanizm ten wie o Tobie o wiele więcej niż najbliższa Ci osoba i znajomi. Zastanów się nad tym, ponieważ w sieci NIC nie ginie i nie zostaje zapomniane, a my nie mamy nad przepływem, przechowywaniem i wykorzystaniem tych informacji ŻADNEJ KONTROLI.

Materiał pisałem 2 lata temu, więc kilka rzeczy mogło ulec zmianie. W razie czego proszę o sprostowania, a jeśli ktoś posiada jakieś ciekawe informacje w tym temacie, również będę zobowiązany.

Ku zastanowieniu. Pozdrawiam wszystkich.

- Blog

- Zaloguj się albo zarejestruj aby dodać komentarz

- 8344 odsłony

Komentarze

Źle oceniony komentarz

Komentarz użytkownika pitekantropus nie został doceniony przez społeczność niepoprawnych.. Odsuwamy go troszkę na dalszy plan.

Prawdziwa cnota podsłuchów się nie boi.1 Grudnia, 2010 - 01:01

Cywilizacja powinna dążyć do stanu

w którym wszyscy wiedzą wszystko.

Łatwo wtedy lokalizować źródła zła lub mechanizmy jego powstawania.

Jedyna zasada : Żyć tak by nie krzywdzić innych.

I powinny jej pilnować maszyny,

bo ludzie potrafią mieć strasznie pokręcone potrzeby.

Wobec niedoskonałości człowieka,

każdy osobnik powinien być wyposażony w urządzenie

rejestrujące obraz i dźwięk,

zapis którego byłby odtwarzany w momentach spornych.

Matka Teresa nie musiała nic ukrywać,

a pedofil i gangster wiedzą, że powinni się czaić.

He he he ...

Już widzę to przerażenie ...

Źle oceniony komentarz

Komentarz użytkownika Harcerz nie został doceniony przez społeczność niepoprawnych.. Odsuwamy go troszkę na dalszy plan.

Re: Prawdziwa cnota podsłuchów się nie boi.1 Grudnia, 2010 - 01:06

-wole sex przy firankach:)

Źle oceniony komentarz

Komentarz użytkownika pitekantropus nie został doceniony przez społeczność niepoprawnych.. Odsuwamy go troszkę na dalszy plan.

I pewnie po ciemku, jak to druh Boruch ...1 Grudnia, 2010 - 01:44

Ale to nie jest istotne,

dopóki nie krzywdzisz za tymi firankami np, bezbronnego zwierzęcia :

które się później na Ciebie skarży ...

Re: InterMacki - Monitoring mediów elektronicznych

1 Grudnia, 2010 - 01:28

To jest takie typowe zagadnienie szpiegowskie:

My wiemy

Oni wiedzą, że my wiemy

My wiemy, że oni wiedzą, że my wiemy

Ale czy oni wiedzą, że my wiemy, że oni wiedzą, że my wiemy

itd, itd. .....

Należy zostawiać możliwie mało "śladów" w sieci, niezależnie czy korzystamy z Googla, czy czegokolwiek innego, nie posiadać konta internetowego w banku nie dokonywać transakcji za pomocą kart płatniczych przy płaceniu za cokolwiek istotnego.

W sklepie najpierw podejść do bankomatu, wyjąć pieniądze a potem w kasie płacić gotówką. To niby niedużo ale ma znaczenie.

Andrzej.A

Venenosi bufones pellem non mutant Andrzej.A

Echelon w Polsce Prawda

24 Września, 2016 - 18:31

Echelon w Polsce: http://www.tylkoprawda.com/fakty/inwigilacja-podsluchy-echelon-w-polsce/